|

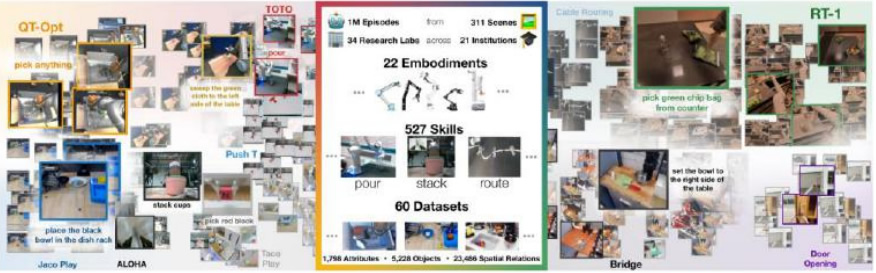

谷歌 DeepMind 在官网发布了大通用大模型之一 RT-X,并开放了训练数据集

Open X-Embodiment。该数据集来自 21 个研究机构,包含在 22 种类型的机器人上采集的超过 15

万个任务的上百万条数据,展示了 527 项技能。诸多人工智能科学家表示,机器人模型的

ImageNet 时刻到来了

采用 Open X-Embodiment 训练的 RT-X性能表现大幅提升。DeepMind分别基于 RT-1和 RT-2,

采用 Open X-Embodiment 数据集进行训练得到了 RT-1-X 和 RT-2-X,得益于更多样化、跨实体

的训练数据,性能表现较原有模型均有大幅提升。在相同的模型架构下,使用 Open X�Embodiment 数据集训练的 RT-1-X 平均性能优于原始模型 50%。RT-2-X 则可以执行从未训练的

操作,涌现能力达到了RT-2的三倍,包括对空间的更好理解,动作的细腻程度等。例如,让机器

人把苹果拿到布附近,而不是拿到布上面,RT-2-X 都能很好的区别这些指令的差异,并做出相应

的动作。

DeepMind 的这项新研究表明,通过利用更多样化的数据和更好的模型进行扩展学习,有可能开

发出更有用的辅助机器人。基于大量机器人数据训练得到的通用大模型可以在不同环境下应用,

无论是在谷歌 DeepMind 的机器人上,还是在世界各地不同大学的机器人上,其性能都得到了显著提G。未来的另一个方向是进一步探索不同数据集的混合会如何影响跨具身智能体泛化,以及

这种泛化是如何是实现的。

|